TUS-Navigateur est un système de neuronavigation conçu pour les ultrasons transcrâniens.

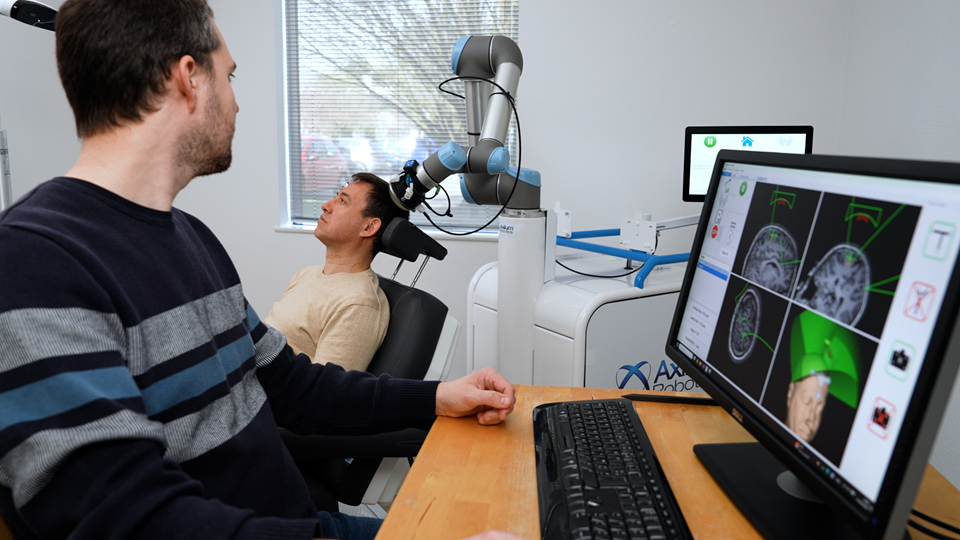

Vue de TUS-Navigateur pilotant un TUS-Cobot

TUS-Navigator est un dispositif destiné exclusivement à un usage expérimental.

Le système utilise une caméra NDI Polaris Vega ST avec pyramide étendue, d’un pointeur et de marqueurs portant des lentilles Radix.

Principales caractéristiques :

- Chargement d’images :

Format DICOM

Format NIFTI

Utlisation du modèle MNI

- Visualisation :

Visualisation des trois coupes 2D (axiale, coronale, sagittale)

Visualisation 3D des segmentations, cibles, marqueurs, et outils

- Visualisation 2D :

Navigation dans les coupes

Ajustement du contraste (niveau de la fenêtre)

Ajustement du zoom (in/out)

Mesure de distance entre deux points

- Visualisation 3D :

Translation et rotation de la scène 3D

Affichages des images pour tous les objets

Affichage de la position actuelle de la cible et du curseur dans plusieurs systèmes de coordonnées (image/centre du volume/MNI/Talairach)

- Segmentation :

Segmentation de la peau

Segmentation du cerveau (à l’aide d’un outil externe)

- Ciblage :

Définition des cibles sur les images 2D

Définition des cibles par coordonnées (à l’intérieur d’une image)

Projection automatique du point d’entrée sur la peau après définition de la cible

Possibilité de positionner le point d’entrée sur les images 2D

Possibilité de changer l’orientation du point d’entrée

Possibilité de changer l’offset du point d’entrée (selon l’axe entrée/cible)

Modification de la visualisation pour que les coupes 2D suivent l’axe entrée/cible

- Recalage patient/IRM :

Définition des repères anatomiques pour le recalage initial (au moins 3 points)

Recalage de surface

- Recalage Talairach :

Possibilité de recaler l’IRM sur le modèle Talairach

- Recalage IRM/CT :

Possibilité de recaler le scan CT du patient (format DICOM ou NIFTI) sur son scan IRM

- Intégration du transducteur :

Possibilité d’afficher la position théorique du point focal

Possibilité de changer la position théorique du point focal en modifiant le pilotage électronique du transducteur

- Pilotage du Cobot :

Interconnexion avec la plateforme Cobot d’Axilum Robotics

Mise sous puissance et initialisation du bras

Mouvement manuel

Vérification du capteur de pression du transducteur

Ajustement de la sensibilité du capteur de pression

Alignement et suivi de la cible

Ajustement de l’offset pendant le suivi (pour déplacer le transducteur plus près/plus loin)

- Superpositions :

Possibilité d’afficher les couches générées par le logiciel (peau/cerveau/CT)

Intégration éventuelle d’un outil de simulation acoustique

- API :

Possibilité d’interagir avec le logiciel à l’aide de commandes textuelles (exemples d’implémentation en Python et MATLAB)